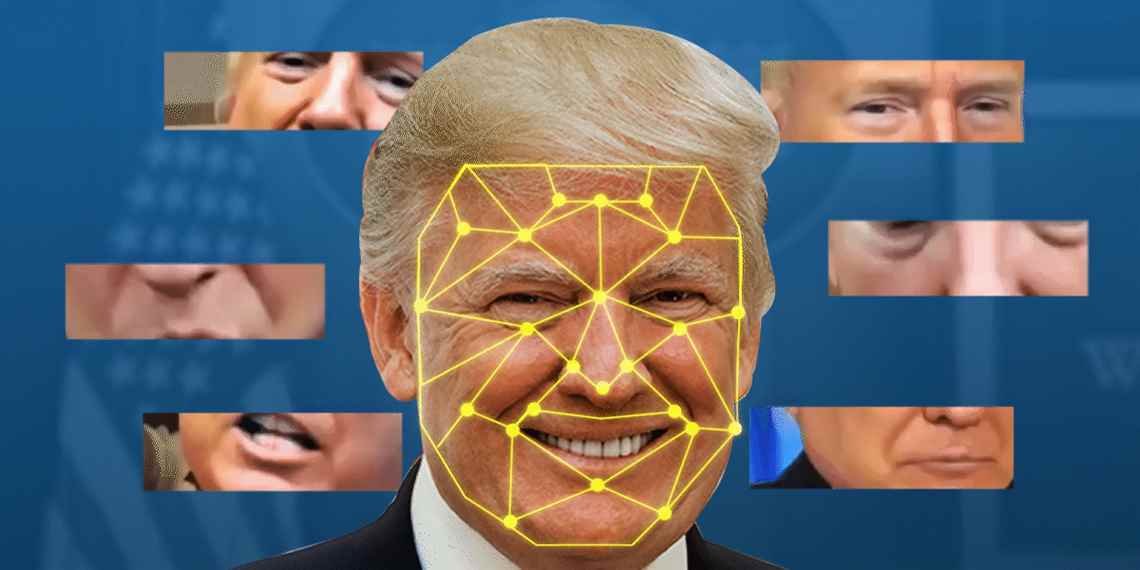

Reportagem apurou que aplicativo pretende lançar rostos de personalidades brasileiras; o Impressions App já permite simular imagem de Trump e Obama, além de celebridades dos EUA

Por Ethel Rudnitzki, Agência Pública

“Hey, Brasil. Estou em praia de Rio de Janeiro pescando”, diz o cantor Justin Bieber, em português, em um vídeo gravado em Cabo Frio. Com mais de 80 mil curtidas, o conteúdo em questão não foi produzido pelo cantor, mas por um influencer brasileiro, Daniel Xavier, utilizando um aplicativo que permite trocar seu rosto pelo de celebridades e políticos — e que pode mudar a forma como conteúdos falsos são produzidos atualmente.

Por R$ 20,90 a semana, qualquer pessoa com um celular com sistema operacional IOS pode, em poucos minutos, criar vídeos de até 20 segundos, trocando seu rosto pelo de uma celebridade através de deepfakes, técnicas que usam inteligência artificial e escaneamento de imagens. Além de Bieber, o aplicativo permite utilizar os rostos das cantoras Rihanna, Miley Cyrus e Alicia Keys, de atores como Angelina Jolie, Brad Pitt e Morgan Freeman, e também de políticos como Donald Trump e Barack Obama. Ao todo, são 80 rostos, todos de pessoas estrangeiras. O aplicativo também inclui falas reais das personalidades para serem dubladas pelos usuários.

Lançado nos EUA em fevereiro, o Impressions App está disponível no Brasil desde 28 de março e ganhou popularidade através dos vídeos do “Justin Bieber brasileiro”. Segundo dados enviados pela Impressions à Agência Pública, os brasileiros já são a segunda maior nacionalidade na plataforma, com 20% do total de usuários — o número total de downloads não foi informado. O aplicativo é propriedade da Synthesized Media, fundada pelos desenvolvedores Murat Deligoz e Ari Bencuya, que saíram da empresa de inteligência artificial aplicada a marketing, AdVelvet.

O Impressions não é o primeiro a disponibilizar ferramentas para criar deepfakes: o chinês ZAO permite que o usuário coloque seu rosto em vídeos famosos; o Doublicat, dos EUA, também. A novidade do aplicativo, contudo, é a alta resolução das imagens e a possibilidade de usar o rosto de celebridades em diferentes contextos, que abrem brechas para um potencial uso danoso da tecnologia.

Segundo Sam Gregory, pesquisador e diretor de projeto da Witness, organização que defende os direitos humanos através de recursos audiovisuais, é cada vez mais comum que recursos de inteligência artificial e deepfakes sejam disponibilizados através de aplicativos, mas o Impressions oferece recursos mais perigosos. “Ele se aproxima mais de possíveis usos maliciosos de deepfakes que os outros, porque através dele você se apropria do rosto de outra pessoa, não do corpo”.

O plano das deepfakes para decolar no Brasil

Segundo a Pública apurou, o Impressions pretende disponibilizar “rostos” de celebridades brasileiras ainda em 2020. “Temos planos para adicionar estrelas locais até o final do ano”, afirmou à reportagem Ari Bencuya, um dos fundadores do Impressions, sem dizer quais personalidades estão sendo estudadas. Toda segunda-feira, o aplicativo adiciona pelo menos três novas personalidades à plataforma.

A reportagem também descobriu que o Impressions tem buscado parcerias com influenciadores locais para investir no mercado brasileiro. Conhecido por produzir vídeos satíricos de deepfakes com o presidente Jair Bolsonaro, Bruno Sartori foi convidado pela empresa para divulgar a tecnologia no Brasil. “Eu não fechei com eles por receio de não saber o que a plataforma quer, e quais medidas ela vai tomar para que as pessoas não criem qualquer tipo de conteúdo nela”, revelou à reportagem.

Sartori conta que questionou o Impressions à respeito de como o app evitaria o uso da tecnologia de deepfakes para a criação de vídeos maliciosos, com desinformação, ou conteúdo sexual não consensual, mas não obteve resposta. “Eles falaram que estavam chegando agora no Brasil e que ainda não tinham estrutura para dar essas respostas”, comenta.

A Pública também questionou os fundadores do aplicativo sobre como pretendem evitar e punir o mau uso da ferramenta. A empresa listou algumas medidas adotadas, como a inserção de marcas d’água nos vídeos manipulados pela plataforma, limitação do tempo de vídeo, controle dos rostos disponíveis e um monitoramento ativo dos conteúdos publicados.

Para Sartori, no entanto, essas medidas “não são tão efetivas quanto deveriam ser”. “Se você quiser remover a marca d’água, você remove. Daí já cai por terra um dos aspectos que eles alegam que evitaria [o mau uso]. Se o sujeito tem realmente a intenção de usar aquele conteúdo para a criação de um vídeo falso, se ele quiser fazer um vídeo de um minuto e o aplicativo só aceita vinte segundos, ele divide o vídeo em três e aí tem o conteúdo completo”, avalia.

Segundo os termos de uso do aplicativo, é proibido usuários com menos de 13 anos de idade e contas automatizadas. O app também diz não é permitir usar a ferramenta para propaganda ou vendas, ou para produzir conteúdos contendo nudez, discurso de ódio ou assédio direcionado. O Impressions ainda se compromete, através de um “manifesto ético”, a banir usuários que violarem essas regras e a cooperar com a Justiça dos países em que está disponível para investigar casos de uso malicioso da tecnologia.

Sartori, no entanto, aponta que esse compromisso também não é muito efetivo, uma vez que o aplicativo não possui representação no Brasil e o processo para acionar uma empresa estrangeira é muito complexo. A exigência que plataformas de mídias sociais tenham representação legal no Brasil é uma demanda levantada por membros da CPMI das Fake News, para a facilitar a investigação de crimes virtuais.

“Se uma ferramenta [de deepfake] é feita para entretenimento, ela deve deixar facilmente detectável que se trata de uma manipulação, para não causar problemas para as pessoas”, defende Gregory.

Segundo o pesquisador, o aplicativo também deveria investir em ferramentas de detecção de vídeos manipulados – uma promessa que o Impressions deixa para o futuro. “Nós temos planos para desenvolver modelos de detecção de deepfakes a partir das mídias em nossos servidores”, afirma o COO, Ari Bencuya. “É fácil prometer. Eu acredito que seria importante investir nisso desde o início”, rebate Gregory.

Nos EUA, Trump já utiliza vídeos editados para atacar adversários

Apesar das deepfakes serem frequentemente utilizadas para entretenimento e sátira, há registros de vídeos manipulados sendo usados por políticos com potencial para difamar adversários e enganar eleitores.

O presidente dos Estados Unidos, Donald Trump já compartilhou em mais de uma ocasião vídeos manipulados de seu oponente para a corrida eleitoral, Joe Biden. Em março deste ano, ele publicou um vídeo do candidato democrata no qual ele aparenta apoiar a reeleição de Trump. Apesar de ser um vídeo editado, que não chega a ser uma deepfake por não utilizar de inteligência artificial no processo de edição, e que foi compartilhado de maneira sarcástica, o material foi suficiente para confundir eleitores. Em abril, Trump retuitou outro vídeo manipulado de Biden, utilizando uma edição mais realista, na qual ele aparece fazendo caretas. À Pública, o Impressions prometeu excluir o rosto de Trump do aplicativo antes das eleições nos EUA, que acontecem em novembro.

“As pessoas já acreditam em desinformação e têm pouco questionamento no que diz respeito à informação quando ela vem em texto. A gente acredita que quando ela vem em vídeo, o senso crítico das pessoas é ainda menos aguçado. As pessoas tendem a acreditar muito em vídeo”, explica Joana Varon, da Coding Rights, organização de direitos digitais.

Além dos vídeos compartilhados por Trump, circula nas redes americanas um vídeo da presidente da Câmara, Nancy Pelosi, com potencial danoso: o vídeo foi editado de maneira que a deputada democrata aparenta estar bêbada. Também não se trata de uma deepfake propriamente, mas de uma técnica de manipulação chamada de shallowfake – também capaz de confundir usuários e causar dano à reputação.

Ataque à reputação de mulheres, como o vídeo de Pelosi, são um dos principais usos maliciosos das deepfakes. Segundo estudo da empresa americana de proteção contra ameaças visuais, Sensitivity, 95% das deepfakes encontradas online em 2019 eram de vídeos falsos de atos sexuais não consensuais.

A atriz Scarlett Johansson tem sido vítima desse tipo de ataque desde 2018. Seu rosto foi um dos primeiros a ser disponibilizado para a produção de deepfakes no Impressions App, que alega evitar que a ferramenta seja usada para vídeos sexuais através de um algoritmo que busca e deleta conteúdos pornográficos e de nudez. No entanto, o influencer Daniel Xavier, já usou o aplicativo para fazer piada de conotação sexual com o rosto de Justin Bieber. Em um vídeo recente, publicado no dia 9 de agosto, ele aparece, com o rosto do cantor, chupando um picolé de maneira sensualizada.

“As pessoas acham que as deepfakes precisam ser perfeitas para causar um dano. Mas não é esse o problema. Na maioria dos casos de vídeos deepfakes de conteúdo sexual não consensual, as pessoas não acreditam que é de fato uma celebridade naquela cena. É sobre humilhá-las”, explica Sam Gregory, da Witness.

Uso de imagem sem autorização pode ter consequências jurídicas

A autorização de uso de imagens de quem tem os rostos incluídos num aplicativo de deepfake é outro ponto problemático da tecnologia, na avaliação de especialistas em direito digital. Segundo Gregory, aplicativos que disponibilizam a imagem de pessoas para a produção de deepfakes, sejam elas celebridades ou não, precisam de uma autorização. “A ideia de consenso das pessoas que estão sendo manipuladas é importante”, diz.

Questionado sobre se o aplicativo firmou acordo de uso de imagem com as celebridades disponíveis, o Impressions disse que não poderia comentar possíveis contratos. A reportagem entrou em contato com a Universal Records, que representa Justin Bieber e outros artistas cujos rostos estão disponíveis no aplicativo, mas não obteve resposta.

Para Joana Varon, da Coding Rights, a ausência de autorização para uso de imagem “pode ter implicações legais”, mas ela assume que ainda não há debate legal a respeito do tema, uma vez que é uma tecnologia nova.

As leis brasileira e americana permitem que a imagem de pessoas públicas sejam utilizadas para fins de sátira e apropriação criativa. No entanto, o Impressions disponibiliza o rosto de celebridades para os mais diversos fins – proibindo somente através de seus termos o uso da ferramentas para fins comerciais e maliciosos.

“Direito de imagem existe e a gente está entrando em uma nova era de discussão, porque não é propriamente uma cena de filme para uma apropriação criativa. É usar um rosto para manipular e criar uma outra cena”, analisa Varon.

Solução definitiva é educação midiática, aponta pesquisador

Apesar dos riscos e problemas éticos e legais envolvendo as deepfakes, a popularização dessa tecnologia é inevitável, na avaliação de pesquisadores. “O impressions é apenas a ponta do iceberg”, avalia Gregory .”Muitos desenvolvedores estão trabalhando nessa área e está ficando cada vez mais fácil de acessar essa tecnologia, por isso devemos nos preparar para ver mais conteúdos desse tipo em breve.”

Segundo Bruno Sartori, a exposição a esse tipo de conteúdo pode ser benéfica. “Essa tecnologia tem que se espalhar para que daqui a dois anos nas campanhas presidenciais todo mundo saiba que é possível criar conteúdo dessa maneira e que quando um conteúdo desse surgir elas saibam dizer que é falso da mesma maneira que a gente olha para uma foto e reconhece que tem Photoshop”, defende.

Joana Varon também também defende que há usos positivos: “não podemos demonizar a tecnologia”, argumenta. “Existem usos positivos, como o de sátira, que são usos criativos sempre respeitando aí a liberdade de expressão”, aponta.

“É difícil saber se isso está ajudando ou dificultando. A crescente disponibilidade para que qualquer um possa fazer deepfakes facilita também que sejam feitas as coisas com as quais jornalistas e ativistas se preocupam”, pondera Gregory. Para o pesquisador, a solução definitiva é a educação midiática, e as plataformas devem informar aos usuários sobre como usar a tecnologia de maneira adequada. “Existe uma obrigação, quando você faz uma ferramenta como essa, de ensinar as pessoas sobre quando é e quando não é apropriado usá-la. É bom que as pessoas conheçam as deepfakes, mas o que nós realmente queremos que elas façam é refletir sobre os interesses por trás do compartilhamento de informações”, conclui.

—

Imagem destacada: Arte: Bruno Fonseca e Larissa Fernandes/Agência Pública